小说中总是有一些真相的,现在是时候领先科幻反乌托邦一步,确定机器感知对人类的风险了

尽管人们长期以来一直在思考智能机械的未来,但随着人工智能和机器学习的兴起,这些问题变得更加紧迫。这些机器类似于人类互动:它们可以帮助解决问题、创建内容,甚至进行对话。对于科幻小说和反乌托邦小说的粉丝来说,一个迫在眉睫的问题可能就在眼前。如果这些机器发展出一种意识呢

2023年12月31日,研究人员在《社会计算杂志》上发表了他们对这一主题的研究

虽然在这场关于机器中的人工感知(AS)的讨论中没有提供可量化的数据,但在人类语言发展和机器以有意义的方式发展语言所需的因素之间有许多相似之处

作者兼研究员John Levi Martin说:“许多关注机器感知能力发展可能性的人担心我们使用这些机器的道德,或者机器作为理性的计算器是否会攻击人类以确保他们自己的生存。”。“我们担心他们通过过渡到一种特定的语言形式的感知而陷入某种形式的自我疏远。”

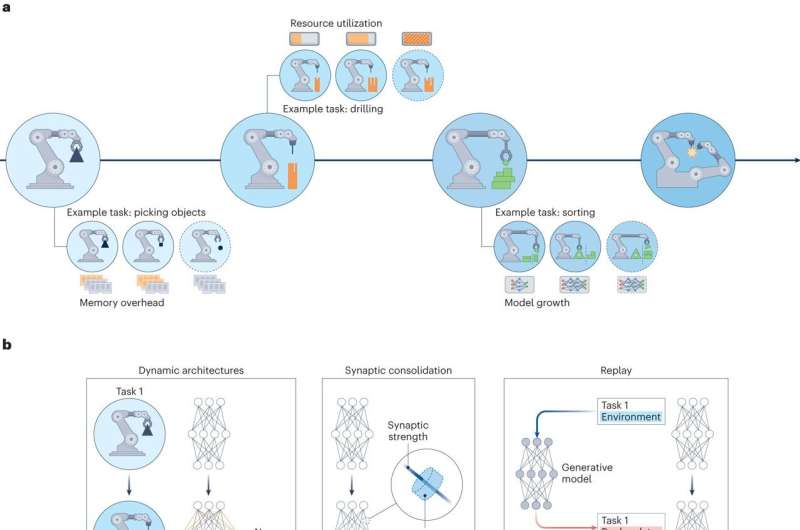

使这种过渡成为可能的主要特征似乎是:非结构化的深度学习,如神经网络(计算机分析数据和训练示例以提供更好的反馈),人类和其他机器之间的互动,以及继续自我驱动学习的广泛行动。自动驾驶汽车就是一个例子。许多形式的人工智能已经勾选了这些复选框,这引发了人们对其“进化”的下一步可能是什么的担忧。

这一讨论指出,仅仅关注机器中AS的发展是不够的,但提出了一个问题,即我们是否为机器中出现的一种意识做好了充分准备。现在,有了人工智能,它可以生成博客文章、诊断疾病、创建食谱、预测疾病或讲述完全符合其输入的故事,想象与一台了解其存在状态的机器建立真正的联系就不远了。然而,这项研究的研究人员警告说,这正是我们需要警惕我们收到的输出的时候

Martin说:“成为一个语言生物更多的是指向对信息的战略控制,并导致整体性和完整性的丧失……这不是我们想要的,因为我们的设备负责我们的安全。”。由于我们已经让人工智能负责我们的大量信息,本质上是依靠它来像人脑一样学习很多信息,所以当以几乎不计后果的方式委托人工智能处理如此多的重要信息时,它已经成为一种危险的游戏

模仿人类反应和战略性地控制信息是两件非常独立的事情。一个“语言存在者”可能有口是心非的能力,并在他们的反应中进行计算。其中一个重要的因素是,我们在什么时候发现自己被机器耍了

未来将掌握在计算机科学家手中,他们将开发策略或协议来测试机器的语言感知能力。使用已经发展出感知或“自我”感的语言形式的机器背后的伦理尚未完全确立,但可以想象这将成为一个社会热点。一个自我意识的人和一个有感知能力的机器之间的关系肯定是复杂的,这种类型的亲属关系的未知水域肯定会带来许多关于伦理、道德和继续使用这种“自我意识”技术的概念

想要了解更多关于脑机接口技术的内容,请关注脑机网,我们将定期发布最新的研究成果和应用案例,让您第一时间了解脑机接口技术的最新进展。